Stand: 4. Mai 2026 · Lesezeit: 5 Min.

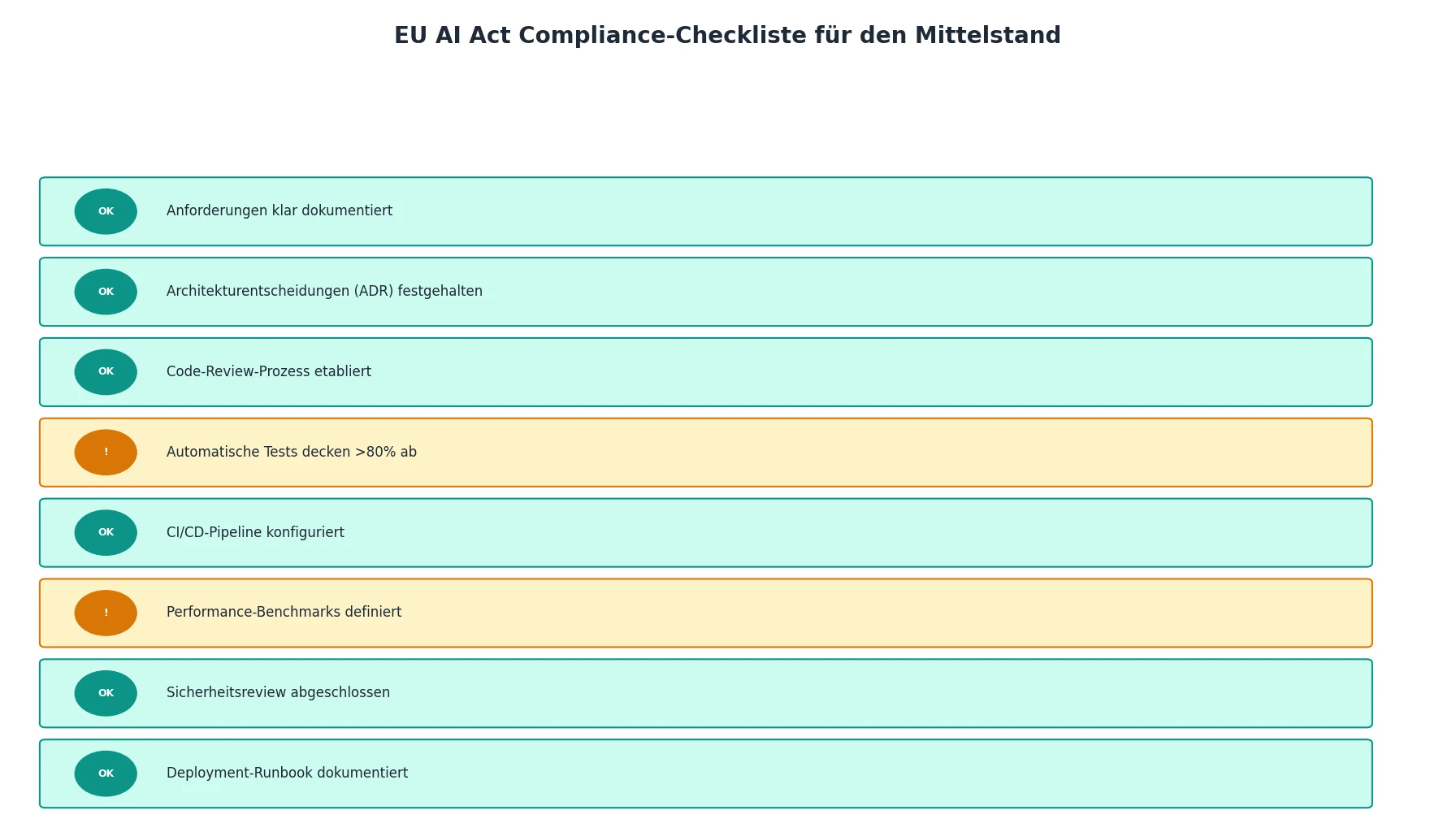

Dieser Fachartikel behandelt: EU AI Act Compliance-Checkliste für den Mittelstand.

“Digitalisierung ist kein IT-Projekt – es ist eine Geschäftsstrategie.”

– Björn Groenewold, Geschäftsführer Groenewold IT Solutions

Diese EU AI Act Compliance-Checkliste richtet sich an mittelständische Unternehmen, die KI-Systeme einsetzen (Betreiber) oder in Auftrag geben (faktischer Anbieter). Sie ersetzt keine Rechtsberatung für Einzelfälle, gibt aber eine strukturierte Arbeitsbasis für den Einstieg in die AI-Act-Compliance.

Den vollständigen Hintergrund zum EU AI Act finden Sie in unserem Beitrag EU AI Act: Was Unternehmen 2026 wissen müssen und zur Hochrisiko-Klassifizierung.

Phase 1: Bestandsaufnahme

Kurz: ☐ KI-Inventar erstellen Erfassen Sie alle KI-Systeme im Unternehmen – auch eingebettete KI-Funktionen in bestehender Software (HR-Tools, CRM, ERP, Marketing-Plattformen, Recruiting-Software).

☐ KI-Inventar erstellen Erfassen Sie alle KI-Systeme im Unternehmen – auch eingebettete KI-Funktionen in bestehender Software (HR-Tools, CRM, ERP, Marketing-Plattformen, Recruiting-Software).

Für jedes System erfassen:

- Name, Anbieter, Version

- Zweck und eingesetzte Bereiche

- Verarbeitete Datenarten

- Entscheidungen, die das System unterstützt oder trifft

- Anzahl betroffener Personen (Mitarbeiter, Kunden, Dritte)

☐ Eigene Rolle klären Sind Sie Anbieter, Betreiber, Importeur oder Händler? Bei intern entwickelter KI: Anbieter. Bei zugekauften Systemen: Betreiber. Bei Beauftragung einer Agentur für Kundensoftware: Anbieter.

☐ Verbotene Systeme prüfen Nutzen Sie Systeme für Social Scoring, biometrische Echtzeit-Überwachung oder unbewusste Manipulation? Falls ja: Sofortige Abschaltung oder Rechtsberatung.

Phase 2: Klassifizierung

Kurz: ☐ Anhang-I-Check Sind KI-Systeme als Sicherheitsbauteile in regulierten Produktkategorien integriert?

☐ Anhang-I-Check Sind KI-Systeme als Sicherheitsbauteile in regulierten Produktkategorien integriert? (Maschinen, Medizinprodukte, Fahrzeuge, Aufzüge etc.)

☐ Anhang-III-Check Fallen Systeme in einen der acht Hochrisiko-Bereiche?

- Biometrische Identifikation ☐

- Kritische Infrastruktur ☐

- Bildung / Ausbildung ☐

- Beschäftigung / HR ☐

- Wesentliche Dienstleistungen (Kredit, Versicherung) ☐

- Strafverfolgung ☐

- Migration / Asyl ☐

- Rechtspflege ☐

☐ Ausnahmen prüfen Greift die Hilfsfunktions-Ausnahme? Begründung schriftlich dokumentieren.

☐ Klassifizierungsdokumentation erstellen Ergebnis und Begründung für jedes KI-System schriftlich festhalten – auch bei Einstufung als nicht-Hochrisiko.

Phase 3: Pflichten für Hochrisiko-Systeme als Betreiber

Kurz: ☐ Konformitätsdokumentation des Anbieters beschaffen CE-Kennzeichnung, EU-Konformitätserklärung, technische Dokumentation vom KI-Anbieter anfordern.

☐ Konformitätsdokumentation des Anbieters beschaffen CE-Kennzeichnung, EU-Konformitätserklärung, technische Dokumentation vom KI-Anbieter anfordern. Kein Hochrisiko-System ohne diese Unterlagen einsetzen.

☐ Verwendungszweck prüfen Wird das System nur im vom Anbieter vorgesehenen Verwendungszweck eingesetzt? Abweichungen können eigene Anbieter-Pflichten auslösen.

☐ Menschliche Aufsicht sicherstellen Sind Prozesse definiert, bei denen ein Mensch das KI-System überwacht, versteht und übersteuern kann? Dokumentation der Aufsichtsprozesse erstellen.

☐ Eingabedaten prüfen Sind die Eingabedaten relevant und repräsentativ für den Verwendungszweck? Systematische Verzerrungen identifizieren und dokumentieren.

☐ Protokollierung einrichten Werden Betrieb und Entscheidungen des Systems ausreichend protokolliert? Logaufbewahrungsfristen festlegen.

☐ Mitarbeiterschulung Alle Mitarbeiter, die das Hochrisiko-System nutzen oder überwachen, müssen entsprechend geschult sein. Schulungsdokumentation führen.

☐ Vorfallmeldeprozess definieren Bei schwerwiegenden Vorfällen oder Risiken: An wen wird gemeldet, in welcher Frist?

Phase 4: Pflichten für KI als Auftraggeber/Anbieter

Kurz: Wenn Sie KI-Software für Dritte in Auftrag geben und zum faktischen Anbieter werden:

Wenn Sie KI-Software für Dritte in Auftrag geben und zum faktischen Anbieter werden:

☐ Konformitätsbewertungsverfahren planen Für Hochrisiko-Systeme: Welches Verfahren (Selbstbewertung oder notifizierte Stelle)?

☐ Technische Dokumentation nach Anhang IV erstellen Pflichtinhalte: Beschreibung des Systems, Entwicklungsprozess, Trainings- und Testdaten, Risikomanagement, Überwachungsmaßnahmen.

☐ Qualitätsmanagementsystem aufbauen Hochrisiko-Anbieter brauchen ein formales QM-System für den gesamten Lebenszyklus.

☐ Vertragliche Verantwortlichkeiten klären Bei Beauftragung einer KI-Agentur: Wer trägt welche Compliance-Verantwortung vertraglich? Diese Frage bei Softwareentwicklung mit KI-Komponenten von Anfang an klären.

☐ Post-Market-Monitoring-Plan erstellen Wie werden nach dem Go-live Risiken beobachtet, Vorfälle erfasst, Updates gesteuert?

Phase 5: Transparenzpflichten (alle KI-Systeme)

Kurz: ☐ Chatbots und KI-Avatare kennzeichnen Nutzer müssen wissen, dass sie mit KI interagieren.

☐ Chatbots und KI-Avatare kennzeichnen Nutzer müssen wissen, dass sie mit KI interagieren. Hinweis zu Beginn jeder Konversation einbauen.

☐ KI-generierte Inhalte kennzeichnen Texte, Bilder, Videos, die KI generiert hat und öffentlich verwendet werden, sind entsprechend zu kennzeichnen (Deepfake-Regelung).

☐ Mitarbeiterinformation Informieren Sie Mitarbeiter transparent über KI-Systeme, die ihre Arbeit oder Bewertung beeinflussen. Betriebsrat einbinden, wenn vorhanden.

Phase 6: Laufende Governance

Kurz: ☐ AI Act-Verantwortlichen benennen Wer ist im Unternehmen zuständig für AI-Compliance?

☐ AI Act-Verantwortlichen benennen Wer ist im Unternehmen zuständig für AI-Compliance? Klare Verantwortlichkeit festlegen.

☐ Regelmäßige Überprüfung einplanen AI Act und EU-Guidance entwickeln sich weiter. Mindestens jährliche Überprüfung des KI-Inventars und der Klassifizierungen einplanen.

☐ Neue KI-Projekte AI-Act-first prüfen Vor jedem neuen KI-Projekt: Klassifizierung und Compliance-Anforderungen klären, bevor Entwicklung beginnt.

☐ Vertragliche Absicherung bei Zulieferern Stellen Sie in Verträgen mit KI-Dienstleistern sicher, dass diese ihre AI-Act-Pflichten erfüllen und entsprechende Dokumentation liefern.

Hilfreich: Wann externe Unterstützung sinnvoll ist

- Bei der ersten Bestandsaufnahme und Klassifizierung: Externer Blick reduziert blinde Flecken

- Bei Hochrisiko-Systemen, die Sie selbst entwickeln oder in Auftrag geben: Rechtsberatung für Konformitätsbewertung

- Bei unklarer Risikoklassifizierung: Gutachten schafft Rechtssicherheit

- Bei Meldepflichten gegenüber Behörden: Anwaltliche Begleitung empfohlen

Unser Team unterstützt Sie bei der AI-Act-konformen KI-Implementierung und -Beratung. Die Checkliste oben ist ein guter Startpunkt – für den konkreten Einzelfall ist immer die spezifische Systemarchitektur und Nutzungsweise entscheidend.

Häufig gestellte Fragen (FAQ)

Kurz: Gibt es ein offizielles Compliance-Tool der EU?

Gibt es ein offizielles Compliance-Tool der EU? Die EU-KI-Behörde (AIDA) arbeitet an Leitlinien und Tools. Zum Stand 2026 gibt es erste Orientierungsdokumente, aber noch kein vollständiges Selbstassessment-Tool mit Rechtsbindung.

Wann müssen wir mit Kontrollen durch Behörden rechnen? Die nationalen Marktüberwachungsbehörden bauen gerade Kapazitäten auf. Anlassbezogene Prüfungen (nach Beschwerden oder Vorfällen) sind früher zu erwarten als flächendeckende Kontrollen.

Reicht unsere DSGVO-Dokumentation als Grundlage für AI-Act-Compliance? Als Ausgangspunkt teilweise. DSGVO-Folgenabschätzungen (DSFA) für KI-Systeme überschneiden sich mit AI-Act-Anforderungen, sind aber nicht identisch. Beide sind separat zu erfüllen.

Was ist der Unterschied zwischen AI Act und AI Liability Directive?

Der AI Act regelt ex-ante Anforderungen (was darf/muss ein System erfüllen).

Die AI Liability Directive (noch in Abstimmung) regelt ex-post Haftung (wer haftet wenn etwas schiefläuft).

Beide zusammen bilden den EU-Rechtsrahmen für KI.

Über den Autor

Geschäftsführer der Groenewold IT Solutions GmbH und der Hyperspace GmbH

Seit 2009 entwickelt Björn Groenewold Softwarelösungen für den Mittelstand. Er ist Geschäftsführer der Groenewold IT Solutions GmbH (gegründet 2012) und der Hyperspace GmbH. Als Gründer von Groenewold IT Solutions hat er über 250 Projekte erfolgreich begleitet – von Legacy-Modernisierungen bis hin zu KI-Integrationen.

Empfehlungen aus dem Blog

Ähnliche Artikel

Diese Beiträge könnten Sie ebenfalls interessieren.

EU AI Act: Was Unternehmen 2026 jetzt wissen und umsetzen müssen

Der EU AI Act ist seit August 2024 in Kraft und gilt schrittweise bis 2027. Was bedeutet das konkret für mittelständische Unternehmen, die KI einsetzen oder entwickeln lassen? Dieser Beitrag erklärt…

Hochrisiko-KI nach EU AI Act: So klassifizieren Sie Ihre Systeme richtig

Ob ein KI-System als "Hochrisiko" gilt, entscheidet über den gesamten Compliance-Aufwand. Die Klassifizierung ist nicht trivial – und wird von vielen Unternehmen falsch eingeschätzt. Dieser Beitrag…

Onlineshop entwickeln lassen: Was kostet das wirklich?

Onlineshop entwickeln lassen: Kosten, Laufzeiten und Entscheidungshilfe zwischen Standard-Shopsystem und Individuallösung für den Mittelstand.

Kostenloser Download

Checkliste: 10 Fragen vor der Software-Entwicklung

Die wichtigsten Punkte vor dem Start: Budget, Timeline und Anforderungen.

Checkliste im Beratungsgespräch erhaltenPassende nächste Schritte

Relevante Leistungen & Lösungen

Basierend auf dem Thema dieses Artikels sind diese Seiten oft die sinnvollsten Einstiege.

Passende Leistungen

Passende Lösungen

Kosten berechnen

Mehr zu EU AI Act und nächste Schritte

Dieser Beitrag gehört zum Themenbereich EU AI Act. In unserer Blog-Übersicht finden Sie alle Fachartikel; unter Kategorie EU AI Act weitere Beiträge zu diesem Thema.

Zu Themen wie EU AI Act bieten wir passende Leistungen – von App-Entwicklung über KI-Integration bis zu Legacy-Modernisierung und Wartung. Typische Ausgangslagen beschreiben wir unter Lösungen. Erste Kosteneinschätzungen liefern unsere Kostenrechner. Fachbegriffe erläutern wir im IT-Glossar. Fachbücher und Praxisleitfäden zu KI und Software stellen wir unter Publikationen vor; vertiefende Artikel finden Sie unter Themen.

Bei Fragen zu diesem Artikel oder für ein unverbindliches Gespräch zu Ihrem Vorhaben können Sie einen Beratungstermin vereinbaren oder uns über Kontakt ansprechen. Wir antworten in der Regel innerhalb eines Werktags.